একটি দৃশ্য কল্পনা করুন। মার্কিন যুক্তরাষ্ট্রের প্রেসিডেন্ট হুট করে একটি সংবাদ সম্মেলন ডেকে বসলেন। সেখানে তিনি কৃষ্ণাঙ্গদের কটাক্ষ করে খুবই খারাপ একটা কথা বললেন। টিভি ও ইন্টারনেটের মাধ্যমে দ্রুত তা বিশ্বব্যাপী ছড়িয়ে পড়লো। এমন বর্ণবাদী মন্তব্যের জন্য সমগ্র আমেরিকার জনগণ ক্ষোভে ফেটে পড়েছে। তারা অবিলম্বে প্রেসিডেন্টের পদত্যাগ চায়। সাধারণ জনগণ রাস্তায় নেমে পড়েছে। জায়গায় জায়গায় পুলিশ মোতায়েন করা হয়েছে। রাষ্ট্রীয় সকল কর্মকাণ্ড স্থবির হয়ে রয়েছে।

অপরদিকে হোয়াইট হাউসে থাকা সকল কর্মচারীর মাথায় হাত। এমন কোনো সংবাদ সম্মেলন তো ডাকাই হয়নি। তাদের প্রেসিডেন্টও তো কোথাও এমন বক্তব্য দেননি। কিন্তু যে ভিডিওটি চারিদিকে ছড়িয়ে পড়েছে তা দেখেই বোঝা যাচ্ছে এটি প্রেসিডেন্ট নিজেই। একই চেহারা, একই গলার স্বর। এমনকি ভিডিওর ব্যাকগ্রাউন্ডেও অবিকল প্রেসিডেন্টের অফিস। প্রযুক্তি বিশ্লেষকরা অনেক চেষ্টা করেও এই ভিডিও যে নকল তা প্রমাণ করতে পারছে না। অপরদিকে বাইরে পরিস্থিতি ক্রমাগত খারাপ হতে চলেছে।

এবার আরেকটি দৃশ্য কল্পনা করুন। অন্যান্য দিনগুলোর মতোই স্বাভাবিকভাবে আপনার দিন কাটছিল। হঠাৎ কাছের একজন মানুষ ইন্টারনেটে আপনাকে একটি ভিডিও পাঠায়। ভিডিওটি চালু করার পর আপনি রীতিমতো আকাশ থেকে পড়লেন। এটি একটি অশ্লীল ভিডিও এবং ভিডিওর মানুষটি আপনি নিজেই। আপনার কাছে এটা একেবারে স্পষ্ট যে, এমন কোনো ভিডিওতেই আপনি নেই। কিন্তু ভিডিওর মানুষটি দেখতে অবিকল আপনার মতো। চোখ, নাক, হাসি, গলার স্বর হুবহু এক। এখন মানুষ কি আপনার কথা বিশ্বাস করতে চাইবে? আপনার আপনজনেরাই বা কীভাবে এর ব্যাখা করবে? খুব দ্রুত এই আপত্তিকর ভিডিও চারিদিকে ছড়িয়ে পড়ছে। পরিবার ও সমাজে আপনি মুখ দেখাতে পারছেন না। অথচ এখানে আপনার কোনো দোষই নেই।

ফটোশপ ও অন্যান্য কিছু সফটওয়্যার আসার পর থেকে ইচ্ছামতো ও নিখুঁতভাবে নকল ছবি তৈরি করা যায়। তবে নকল ভিডিও বানানো অতটা সহজ ছিল না। ছবিতে একজনের মাথা কেটে অন্য জায়গায় বসানো যতটা সহজ, ভিডিওর ক্ষেত্রে তা ততটা সহজ নয়। কারণ মানুষের গলার আওয়াজ, অভিব্যক্তি, তাকানোর ধরন ইত্যাদি হুবহু নকল করা যেত না। এটি অসম্ভব ছিল একটি নতুন প্রযুক্তি আসার আগ পর্যন্ত।

নকল ভিডিও বানানোর এই প্রযুক্তির নাম ডিপফেক বা ডিপফেক টেকনোলজি। এই প্রযুক্তি ব্যবহার করে যেকোনো মানুষের হুবহু নকল ভিডিও বানানো সম্ভব। মেশিন লার্নিংয়ের প্রয়োগ ঘটানোর মাধ্যমে দিন দিন এই অভিশপ্ত প্রযুক্তিটি আরো নিখুঁতভাবে নকল ভিডিও তৈরি করতে সক্ষম হচ্ছে।

ডিপফেক আসলে কীভাবে কাজ করে?

ডিপফেক বলতে নকল ভিডিও বা অডিওকে বোঝায়। আপাতদৃষ্টিতে তা দেখতে আসল মনে হলেও তা মোটেই আসল নয়। ডিপফেক নামটির মাঝেই এর সংজ্ঞা নিহিত রয়েছে। ডিপ মানে গভীর এবং ফেক মানে নকল। অর্থাৎ ডিপফেক বলতে এমন কিছুকে বোঝায় যা খুবই গভীরভাবে নকল করা হয়েছে। মেশিন লার্নিং হলো ডিপফেক ভিডিও বানানোর প্রধান অস্ত্র। মেশিন লার্নিংয়ের একটি কৌশলের নাম “জেনারেল অ্যাডভারসেরিয়াল নেটওয়ার্ক” (GAN)। এর মাধ্যমে প্রথমে একজন ব্যক্তির বিভিন্ন অভিব্যক্তির হাজারখানেক ছবি সংগ্রহ করা হয়। এরপর সেই ছবিগুলো মেশিন লার্নিংয়ের মাধ্যমে প্রক্রিয়া করে তার মুখের সব ধরনের অভিব্যক্তির একটি সিমুলেশন তৈরি করা যায়। কৃত্রিম বুদ্ধিমত্তার উত্তরোত্তর উন্নতির ফলে ব্যক্তির গলার আওয়াজও হুবুহু নকল করা সম্ভব। এসব ভিডিও ও অডিও নানাভাবে প্রক্রিয়া করে এমন একটি নকল ভিডিও তৈরি করা হয় যা খালি চোখে শনাক্ত করা অনেক কঠিন।

আমাদের দৃষ্টিসীমার পর্যায়কাল ০.১ সেকেন্ড। অর্থাৎ ১০০ মিলি সেকেন্ডের কম সময়ে ঘটে যাওয়া কোনো দৃশ্য আমাদের চোখে বাঁধবে না। কৃত্রিম বুদ্ধিমত্তা দিয়ে তৈরি করা ভিডিওগুলোতে নানা ধরনের রূপান্তর ঘটে এর থেকেও কম সময়ে। তাই খালি চোখের পক্ষে আসল-নকলের যাচাই করা সম্ভব হয় না।

ডিপফেক টেকনোলজি দ্বারা সবচেয়ে বেশি ক্ষতিগ্রস্ত হয় রাজনীতিবিদ ও বিভিন্ন সেলিব্রিটিরা। এর কারণ তাদের নানা ভিডিও, ছবি ইত্যাদি ইন্টারনেটে বেশি সহজলভ্য। একজন অভিনেতার চেহারার বিভিন্ন ধরনের অভিব্যক্তি ইন্টারনেটে পাওয়া সবচেয়ে সহজ। তাই তারাই প্রথমে এই ক্ষতিকর প্রযুক্তির শিকার হয়।

ডিপফেক কতটা বিপজ্জনক?

আধুনিক যুগ ইন্টারনেটের যুগ। আরো স্পষ্ট করে বলতে গেলে সোশ্যাল মিডিয়ার যুগ। একটা খবর সোশ্যাল মিডিয়ার মাধ্যমে যত দ্রুত মানুষের কাছে পৌঁছায়, অন্য কোনো মাধ্যম দ্বারা তা সম্ভব না। তাই বিভ্রান্তি ছড়ানোর জন্য এটি একটি উৎকৃষ্ট জায়গা। কোনো রকম সত্যতা যাচাই করা ছাড়াই খবর দ্রুত ছড়িয়ে পড়ে। গুজব সংবাদ দ্রুত মানুষের মুখে মুখে পৌঁছে যায়। মানুষের চিন্তাধারাকে নিয়ন্ত্রণ করার এর থেকে সহজ পন্থা আর নেই। আর এখানেই ডিপফেক টেকনোলজির জয়জয়কার।

ডিপফেক নিয়ে বিভিন্ন সময়ে বিভিন্ন গুরুত্বপূর্ণ ব্যক্তি দুশ্চিন্তা প্রকাশ করেছেন। মার্কিন যুক্তরাষ্ট্রের ফ্লোরিডা অঙ্গরাজ্যের রিপাবলিকান সিনেটর মার্কো রুবিও এই টেকনোলজিকে পারমাণবিক অস্ত্রের সমতুল্য হিসেবে দাবী করেছেন। তিনি বলেছেন-

“তোমরা যদি মার্কিন যুক্তরাষ্ট্রকে হুমকি দিতে চাও, তাহলে আগে তোমাদের দশটা এয়ারক্রাফট ক্যারিয়ার লাগতো, পারমাণবিক অস্ত্র লাগতো, লং রেঞ্জের মিসাইল লাগতো। কিন্তু আজ তোমাদের কেবল আমাদের ইন্টারনেট ব্যবস্থায় প্রবেশ করতে হবে, ব্যাংকিং ব্যবস্থায় অনুপ্রবেশ করতে হবে, বৈদ্যুতিক গ্রিডের উপর নিয়ন্ত্রণ প্রতিষ্ঠা করতে হবে। কিন্তু শুধু যে জিনিসটা করলেই হয়ে যায়, তা হলো তোমাদের একেবারে বাস্তবসম্মত নকল ভিডিও তৈরি করার ক্ষমতা থাকতে হবে। যেটা আমাদের নির্বাচনকে ক্ষতিগ্রস্ত করবে। অনেক প্রশ্নের সৃষ্টি করবে। দেশকে এক চরম সঙ্কটের মুখে ঠেলে দেবে।“

দ্য ওয়াল স্ট্রিট জার্নালের রিসার্চ ও ডেভেলপমেন্ট বিভাগের প্রধান ফ্রান্সেসকো মার্কোনি বলেছেন-

“পরবর্তী প্রজন্মের যত গুজব সংবাদ কৃত্রিম বুদ্ধিমত্তা দ্বারা পরিচালিত হবে।“

এভাবে সামাজিক, রাজনৈতিক সকল ক্ষেত্রে এটি ব্যাপক প্রভাব বিস্তার করতে পারে। একটি সুখী দম্পতির মধ্যকার ভালোবাসা ও বিশ্বাস নিমেষে ভেঙে চুরমার করে দিতে পারে এই প্রযুক্তি। সৃষ্টি করতে পারে রাজনৈতিক অরাজকতা। কোনটি আসল আর কোনটি নকল তা নিয়ে এক বিশাল দ্বন্দ্ব দেখা দিবে মানুষের মনে। আর আপত্তিকর ভিডিও ছড়ানোর আশঙ্কা তো রয়েছেই।

কিছু বাস্তব উদাহরণ

রাজনৈতিক ঘটনা দিয়েই শুরু করা যাক।

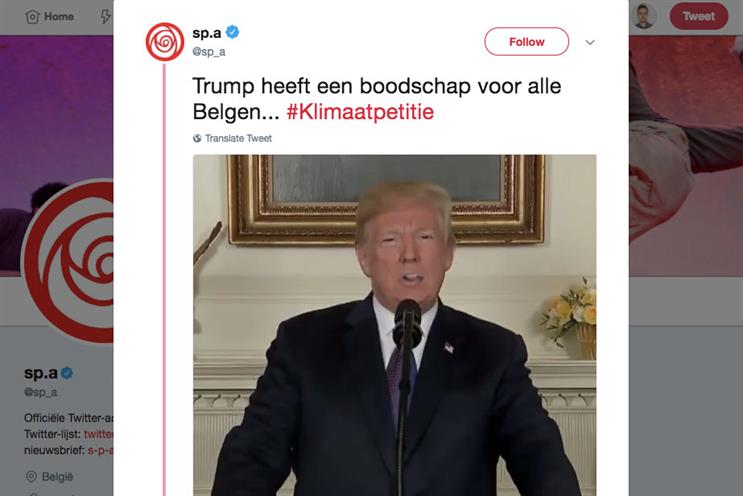

বর্তমান মার্কিন প্রেসিডেন্ট ডোনাল্ড ট্রাম্পকে সবাই চেনেন। নিজের নানা কুখ্যাত বক্তব্যের জন্য এমনিতেই তিনি অনেক জনপ্রিয়। ২০১৮ সালের মে মাসে তার একটি ভিডিও ইন্টারনেটে ছড়িয়ে পড়ে। তাতে তিনি বেলজিয়ামের নাগরিকদের সেই দেশের জলবায়ু পরিবর্তন ইস্যু নিয়ে উপদেশ দিয়েছেন। এই ভিডিওতে তার মুখের ভাষা ছিল খুব খারাপ। বেলজিয়ান জনগণ মার্কিন প্রেসিডেন্টের এমন আচরণ সহজভাবে নেয়নি। তারা টুইটারে প্রেসিডেন্ট ও আমেরিকা নিয়ে অনেক কটু কথা বলতে থাকে। এভাবে এক বিভ্রান্তিকর পরিস্থিতির সৃষ্টি হয়।

পরে জানতে পারা যায় যে, এটি একটি বেলজিয়ান রাজনৈতিক দলের কাজ। তারা একটি প্রোডাকশন স্টুডিওর সাহায্য নিয়ে এই নকল ভিডিও তৈরি করে। তাদের মূল উদ্দেশ্য ছিল জনগণের মনোযোগ আকর্ষণ করা, যাতে জলবায়ু পরিবর্তনের ব্যাপারে বেলজিয়ান সরকার গুরুত্বপূর্ণ পদক্ষেপ নেয়।

এরকম আরো অনেক ঘটনা রয়েছে। সাবেক মার্কিন প্রেসিডেন্ট বারাক ওবামার কথাই ধরুন। তার একটি নকল ভিডিও রয়েছে যাতে তিনি সরাসরি ডোনাল্ড ট্রাম্পকে গালি দিয়েছেন। আগে থেকে বলে না দিলে এই ভিডিও যে আসল না নকল, তা কেউ আঁচ করতে পারবে না। তাহলে একটু চিন্তা করে দেখুন, এই প্রযুক্তি কোনো রাজনৈতিক অরাজকতা সৃষ্টি করতে কত বড় ভূমিকা রাখতে পারে।

উপরে বারাক ওবামার যে ভিডিওটি দেখানো হয়েছে তা আসলে চলচ্চিত্র পরিচালক জর্ডান পিলি ও বাজফিড ওয়েবসাইটের সম্মিলিত প্রয়াসে বের করা হয়। এই ভিডিওর মাধ্যমে তারা ডিপফেক টেকনোলজির খারাপ দিক সম্পর্কে সাধারণ জনগণকে হুঁশিয়ার করে দিয়েছেন।

মিডিয়া জগতে ডিপফেকের ব্যবহার অহঃরহ লেগেই আছে। সেলিব্রিটিদের আপত্তিকর ভিডিওর কথা তো আগেই বলা হয়েছে। চলচ্চিত্রেও এর ব্যবহার থেমে নেই। ইন্টারনেটে একসময় অভিনেতা নিকোলাস কেইজকে নিয়ে বেশ হাস্যরসের সৃষ্টি হয়। বিভিন্ন বিখ্যাত সিনেমার বিভিন্ন চরিত্রে আসল অভিনেতার জায়গায় তার মুখ বসিয়ে ভিডিও ইন্টারনেটে ছেড়ে দেওয়া হয়। এই মাথা কেটে বসানো ভিডিওগুলো ছিল অনেক নিখুঁত ও বাস্তবসম্মত।

‘স্টার ওয়্যারস’ খ্যাত অভিনেত্রী ক্যারি ফিশারকে অনেকেই চিনে থাকবেন। ২০১৬ সালে এই চলচ্চিত্র সিরিজেরই একটি প্রিকুয়েল “রৌগ ওয়ান” মুক্তি পায়। এই সিনেমার এক দৃশ্যে সিরিজের জনপ্রিয় চরিত্র প্রিন্সেস লিয়ার যুবতী সময়ের কিছু দৃশ্য প্রয়োজন ছিল। কিন্তু ক্যারি ফিশার তখন ষাট বছরে পা দিয়েছেন। তাই তার কম বয়সী সংস্করণ তৈরি করতে এই ডিপফেক প্রযুক্তির আশ্রয় নেওয়া হয়। উল্লেখ্য, সিনেমা মুক্তির একই মাসে ২৭শে ডিসেম্বর এই জনপ্রিয় অভিনেত্রী মৃত্যুবরণ করেন।

প্রযুক্তিবিদরা বিভিন্ন নকল শনাক্তকরণ পদ্ধতি নিয়ে গবেষণা করছেন

ডিপফেক ভিডিও শনাক্ত করার জন্য ইতোমধ্যেই গবেষকরা উঠে পড়ে লেগেছেন। বিশেষভাবে বলতে হবে প্রফেসর হ্যানি ফরিদের কথা। ইউনিভার্সিটি অফ ক্যালিফোর্নিয়ার কম্পিউটার বিজ্ঞান বিভাগের এই প্রফেসর প্রায় বিশ বছর ধরে ডিজিটাল জালিয়াতি নিয়ে কাজ করছেন। তিনি এসব নকল ভিডিও শনাক্তকরণের জন্য নানা নতুন কৌশলের উদ্ভাবন করে চলেছেন। সাম্প্রতিক সময়ে এই পথে সাফল্যও অর্জন করেছেন। কথা বলার সময় মানুষের মুখমন্ডলে রক্তপ্রবাহের তারতম্য ঘটে। এটি মেশিন লার্নিং দিয়ে শনাক্ত করা যায় না। তিনি বর্তমানে এ ব্যাপারটি নিয়ে কাজ করছেন। তবে তিনি নিজে এখনো আশঙ্কামুক্ত নন। তার মতে, ডিপফেকের বিরুদ্ধে এসব ফরেনসিক টেকনোলজি বের করতে বছরের পর বছর সময় লেগে যায়। আর ডিপফেক টেকনোলজি প্রতিনিয়ত হালনাগাদ হচ্ছে। তাই এর শনাক্তকরণ পদ্ধতিগুলো গোপন রাখা জরুরী। দিন শেষে এগুলো ফাঁস হয়ে গেলে নকলবাজরা তা কাজে লাগাবে। এলগোরিদমে তাদের সামান্য পরিবর্তন পুরো বছরের শ্রম বৃথা করে দিতে পারে।

ইন্টারনেটের মাধ্যমের নানা গুজব ছড়ানো এখন নিত্যদিনের ব্যাপার। কোনটি সত্য ও কোনটি মিথ্যা তা নিয়ে জনগণ আগে থেকেই অনেক বিভ্রান্ত। তাই এমন অভিশপ্ত প্রযুক্তি যেন আরো শক্তিশালী হয়ে না ওঠে এবং দ্রুত এর প্রতিরোধ ব্যবস্থা গড়ে তোলা যায়, সেজন্য প্রযুক্তিবিদ ও গবেষকদের এগিয়ে আসতে হবে। ইতোমধ্যেই ফেসবুক এসব ডিপফেক ভিডিও শনাক্তকরণের জন্য কাজ করছে। অন্যান্য বিভিন্ন কোম্পানিও এ ব্যাপারে বেশ গুরুত্ব দিচ্ছে।

প্রযুক্তি জগতের চমৎকার সব বিষয়ে রোর বাংলায় লিখতে আজই আপনার লেখাটি পাঠিয়ে দিন এই লিঙ্কেঃ roar.media/contribute/