“জিপিটি-ফোরের চেয়েও শক্তিশালী কৃত্রিম বুদ্ধিমত্তা ব্যবস্থার উদ্ভাবন নিয়ে যেসব পরীক্ষাগার কাজ করে যাচ্ছে, তাদেরকে আমরা আমরা অন্তত ছয় মাসের জন্য কৃত্রিম বুদ্ধিমত্তার এরকম উন্নয়ন স্থগিত রাখার আহ্বান জানাচ্ছি। এই স্থগিত জনসমক্ষে আনতে হবে এবং এর সত্যতা যাচাইয়ের উপযোগী হতে হবে। এ ধরনের সাময়িক স্থগিতকরণ যদি দ্রুত কার্যকর করা না হয়, তাহলে সরকারের উচিত হবে সাময়িক নিষেধাজ্ঞা আরোপের মধ্য দিয়ে সঠিক পদক্ষেপ নেয়া।“

উপরের কথাগুলো একটি খোলা চিঠিতে লেখা হয়েছে, যে চিঠি নিয়ে বিভিন্ন মহলে ইতোমধ্যে বেশ আলোচনা শুরু হয়ে গিয়েছে। যারা চিঠিটি লিখেছেন বা এতে স্বাক্ষর করেছেন, তারা অনুরোধ জানিয়েছেন যেন সম্প্রতি সবার জন্য উন্মুক্ত করে দেয়া ‘জিপিটি-ফোর’কে আরও উন্নত করতে যারা চেষ্টা চালিয়ে যাচ্ছেন, তাদের এই চেষ্টা অন্তত ছয় মাসের জন্য সাময়িকভাবে বন্ধ রাখা হয়। এই স্থগিতকরণ যেন ঠিকমতো কার্যকর করা হয়, সেটাও উল্লেখ করা হয়েছে সেই চিঠিতে। তবে কীভাবে এই স্থগিতকরণের সত্যতা যাচাই করা হবে, তা নিয়ে কিছু বলা হয়নি। প্রয়োজনে সরকারের হস্তক্ষেপের কথাও জানানো হয়।

উপরের আহ্বানগুলো যে খোলা চিঠিতে জানানো হয়েছে, সেই চিঠির প্রকাশক হচ্ছে ‘ফিউচার অব লাইফ ইন্সটিটিউট’ নামের একটি অলাভজনক প্রতিষ্ঠান। প্রযুক্তির অপব্যবহার মানুষের জীবনে হুমকি তৈরি করে, সেসব নিয়েই এই প্রতিষ্ঠানটি কাজ করে থাকে। গত বছর নভেম্বর মাসের ৩০ তারিখে কৃত্রিম বুদ্ধিমত্তা নিয়ে কর্মরত প্রতিষ্ঠান ‘ওপেনএআই’ (OpenAI) চ্যাটজিপিটি নামের একটি কৃত্রিম বুদ্ধিমত্তাসম্পন্ন চ্যাটবট সবার জন্য উন্মুক্ত করে দেয়। এই চ্যাটবটকে কোনো প্রশ্ন করলে বা নির্দেশনা প্রদান করলে অতি অল্প সময়ে সেই প্রশ্নের উত্তর দিতো কিংবা নির্দেশনায় যেসব তথ্য চাওয়া হয়, সেগুলো দেয়া হতো। কৃত্রিম বুদ্ধিমত্তা নিয়ে আলোচনা-সমালোচনা আগেও কম-বেশি চলমান থাকলেও এই চ্যাটবট উন্মুক্ত করে দেয়ার পর থেকে সেটি নতুন মাত্রা লাভ করে। এ বছরের মার্চ মাসের ১৪ তারিখে জিপিটি সিরিজের চতুর্থ সংস্করণ ‘জিপিটি-৪’ বাজারে আনার ঘোষণা দেয় ওপেনএআই। এটি ছিল তার পূর্বের সংস্করণের চেয়ে আরও বেশি দক্ষতাসম্পন্ন ও নির্ভুল।

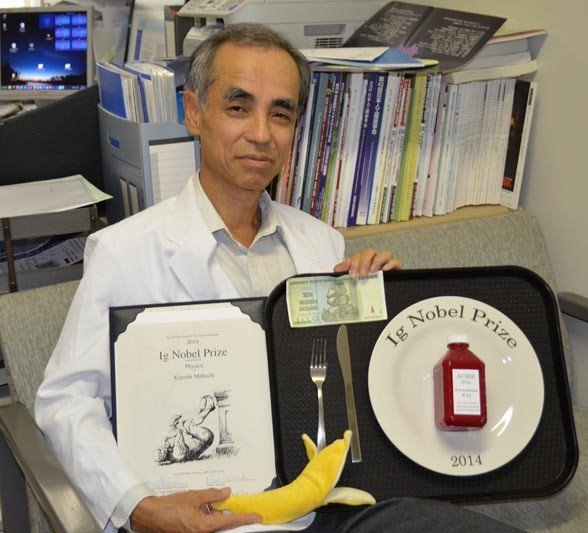

জিপিটি-৪ বের করার পরই মাইক্রোসফট এবং ওপেনএআই যে আরও ভালো কৃত্রিম বুদ্ধিমত্তার সংস্করণের জন্য চেষ্টা চালিয়ে যাচ্ছে, সেটি পূর্বের অভিজ্ঞতা থেকে পরিস্কার হয়ে যায়। শুধু এই দুটি আলোচনায় থাকলেও আরও অনেকগুলো পরীক্ষাগার জিপিটি-৪ এর চেয়ে অধিকতর শক্তিশালী কৃত্রিম বুদ্ধিমত্তা ব্যবস্থার উদ্ভাবন নিয়ে কাজ চালিয়ে যাচ্ছে। এর পরিপ্রেক্ষিতে গত ২২ মার্চ এক খোলা চিঠি প্রকাশ করা হয়, যেখানে এখন পর্যন্ত এগারোশোরও বেশি বিজ্ঞানী, প্রযুক্তিবিশ্বের নেতা এবং উদ্যোক্তা স্বাক্ষর করেছেন। স্বাক্ষরদাতাদের মধ্যে রয়েছেন এলন মাস্ক, স্টিভ ওজনিয়াক, জশুয়া বেনজিও ও ইউভাল নোয়াহ হারারির মতো ব্যক্তিরা। এলন মাস্ক অত্যাধুনিক গাড়িনির্মাতা প্রতিষ্ঠান টেসলার প্রতিষ্ঠাতা। স্টিভ ওজনিয়াক বিখ্যাত প্রযুক্তি প্রতিষ্ঠান ‘অ্যাপল’ এর সহ-প্রতিষ্ঠাতা। জশুয়া বেনজিও একজন পুরস্কারপ্রাপ্ত কৃত্রিম বুদ্ধিমত্তা গবেষক এবং ইউভাল হারারি সুবিখ্যাত ‘স্যাপিয়েন্স’ বইয়ের লেখক।

চিঠিতে কয়েকটি বিষয় নিয়ে উদ্বেগ প্রকাশ করা হয়েছে। এই বিষয়গুলো হচ্ছে– মিথ্যা তথ্যের ছড়াছড়ি, প্রচুর মানুষের চাকরি চলে যাওয়ার শঙ্কা, মানুষের বুদ্ধিমত্তার প্রতিস্থাপন এবং সভ্যতার উপর আমাদের নিয়ন্ত্রণ হাতছাড়া হওয়া। এছাড়া কৃত্রিম বুদ্ধিৃমত্তা গ্রহণের জন্য যথেষ্ট সময় ও ব্যবস্থাপনার অভাব।

সম্প্রতি চ্যাটজিপিটি এবং জিপিটি-৪ এর উত্থানের পর অসংখ্য মানুষ তথ্যের উৎস হিসেবে কৃত্রিম বুদ্ধিমত্তার এই দুটো সংস্করণকে বেছে নিয়েছেন। এখানেই মিথ্যা তথ্য বা ভুল তথ্য ছড়িয়ে যাওয়ার মূল সমস্যা নিহিত। সাধারণত আমরা একটি ঘটনার বিভিন্ন দৃষ্টিভঙ্গি থেকে দেখে থাকি। বিভিন্ন দৃষ্টিভঙ্গি থেকে একটি ঘটনাকে পর্যবেক্ষণ করার পর তার প্রকৃত চিত্র আমাদের সামনে ভেসে ওঠে। এছাড়াও সাধারণভাবে একটি ঘটনার বর্ণনা সম্পর্কে সন্দেহের উদ্রেক হলে আমরা সেই ঘটনার বর্ণনা আরেকটি উৎস থেকে পেতে পারি। এভাবে সত্যতা যাচাই করলে ভুল বর্ণনা পাওয়ার সম্ভাবনা কমে যায় একেবারেই। কিন্তু কৃত্রিম বুদ্ধিমত্তার ক্ষেত্রে এরকম সুবিধা নেই। এখানে ভুল কোনো তথ্য দেয়া হলে সেটিই লাখ লাখ মানুষের কাছে পৌঁছাবে৷ আর কৃত্রিম বুদ্ধিমত্তা ব্যবস্থার উপরে মানুষের অতিনির্ভরশীলতার ফলেও মানুষের অন্য কোথাও গিয়ে সত্যতা যাচাই করার প্রয়োজন বোধ করবে না। ফলে ভুল তথ্য কিংবা প্রোপাগাণ্ডা ছড়ানোর একটি প্লাটফর্ম হিসেবে কৃত্রিম বুদ্ধিমত্তা ব্যবস্থাকে বাদ দিয়ে দেয়া যাচ্ছে না।

কৃত্রিম বুদ্ধিমত্তার ফলে যে অসংখ্য মানুষের কর্মসংস্থান চলে যাবে, তা অনুমান করা হচ্ছিল আগে থেকেই। এই অনুমান মোটেও অমূলক নয়। বর্তমানে অনেক মানুষ যে কাজ করছে, সেটি যদি একটি ভার্চুয়াল প্লাটফর্ম করে দিতে পারে, তাহলে একটি প্রতিষ্ঠান স্বাভাবিকভাবেই বাড়তি জনবলকে ছাটাই করবে। এর সাথে মানু্ষের বুদ্ধিমত্তার প্রতিস্থাপন ও সভ্যতার উপর মানুষের নিয়ন্ত্রণ হাতছাড়া হওয়াও সম্পৃক্ত। আশঙ্কা করা হচ্ছে, যদি মানুষের বুদ্ধিমত্তাকে প্রতিস্থাপন করা হয়, তাহলে পৃথিবীতে মানুষের গুরুত্বও কমে যাবে। কৃত্রিম বুদ্ধিমত্তা তখন মানুষের জায়গা দখল করবে। এর ফলে একপর্যায়ে মানবসভ্যতার সুশৃঙ্খল সমাজকাঠামোই হয়তো সংকটে পড়বে।

চিঠিতে মূলত অন্তত ছয় মাস সময় চাওয়া হয়েছে সাম্প্রতিক কৃত্রিম বুদ্ধিমত্তা প্রযুক্তির সাথে খাপ খাইয়ে নেয়ার জন্য। অতীতে দেখা গিয়েছে, এক প্রজন্মের পর আরেক প্রজন্মের প্রযুক্তির উন্নয়নের সাথে মানুষ ধারাবাহিকভাবে খাপ খাইয়ে নিয়েছে। কিন্তু সম্প্রতি যেভাবে একের পর এক কৃত্রিম বুদ্ধিমত্তা ব্যবস্থাগুলো উদ্ভাবন ও সাধারণ মানুষের জন্য উন্মুক্ত করা হয়েছে, তাতে বিশৃঙ্খলা ও অব্যবস্থাপনা লক্ষ্য করা যাচ্ছে। ফলে একটি পর্যায় থেকে আরেকটি পর্যায়ে উন্নীত হওয়ার প্রস্তুতির জন্য যে সময়টি দরকার, সেটিই নিশ্চিতকরণের জন্য বিজ্ঞানী, গবেষক ও প্রযুক্তি বিশ্বের নেতারা আহ্বান জানিয়েছেন।

আলোচনার কেন্দ্রবিন্দুতে থাকা এই চিঠির উত্তরে কৃত্রিম বুদ্ধিমত্তার পরীক্ষাগারগুলো এখনও উল্লেখযোগ্য কিছু জানায়নি। ওপেনএআইয়ের মুখপাত্র বলেছেন, তারা আরও উন্নত কৃত্রিম বুদ্ধিমত্তা ব্যবস্থা নিয়ে এখনই সেভাবে কাজ শুরু করেননি। এই চিঠির অনেক সমালোচক বলছেন, প্রযুক্তির উন্নয়নকে চাইলেও আটকানো সম্ভব নয়। কৃত্রিম বুদ্ধিমত্তা ব্যবস্থা নিয়ে সম্প্রতি যে আলোড়ন ও অপার সম্ভাবনা তৈরি হয়েছে, তাতে করে কৃত্রিম বুদ্ধিমত্তা নিয়ে কাজ করা প্রতিষ্ঠানগুলো এত সহজে নতুন সংস্করণের পথ থেকে ফিরে আসবে বলে নিশ্চিত হওয়া যাচ্ছে না। কিন্তু সাময়িক স্থগিতকরণের প্রস্তাব যদি গ্রহণ করা হয়, তবে ভবিষ্যতের অনেক বিশৃঙ্খলা এবং বিপর্যয় থেকে মুক্তি পাওয়া যাবে।